LLaMA : Open and Efficient Foundation Language Models

Meta info.

- Authors: Hugo Touvron,Thibaut Lavril, Gautier Izacard

- Paper: https://research.facebook.com/file/1574548786327032/LLaMA--Open-and-Efficient-Foundation-Language-Models.pdf

- Affiliation: Meta AI

- Code: https://github.com/facebookresearch/llama

TL; DR

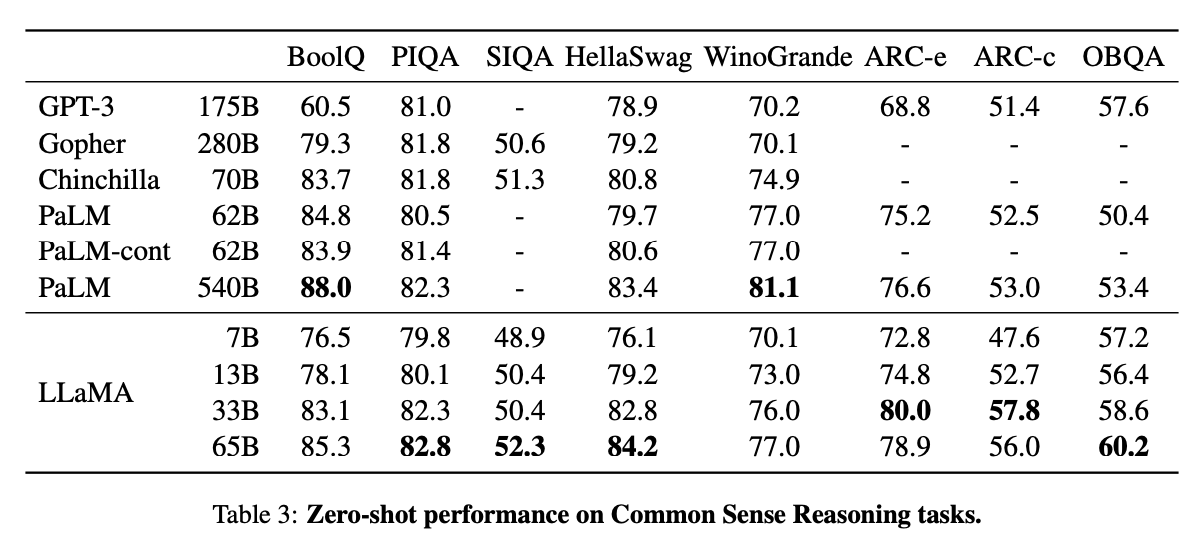

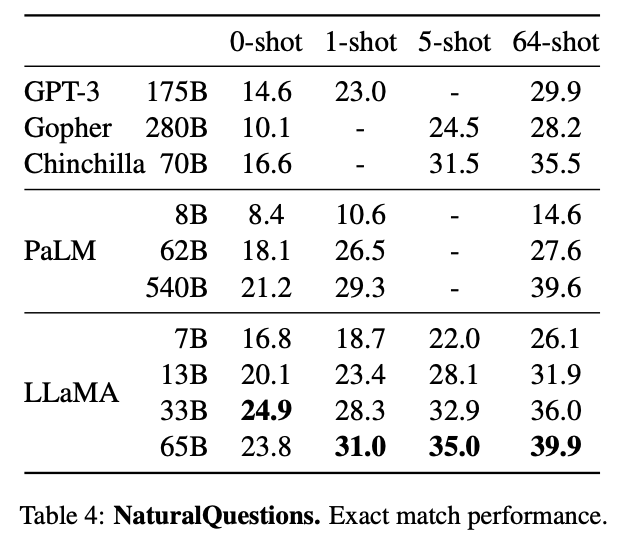

10배 더 적은 파라미터(13B)로 GPT-3 175B 대비 거의 모든 벤치마크에서 더 나은 성능 달성.

Suggestions

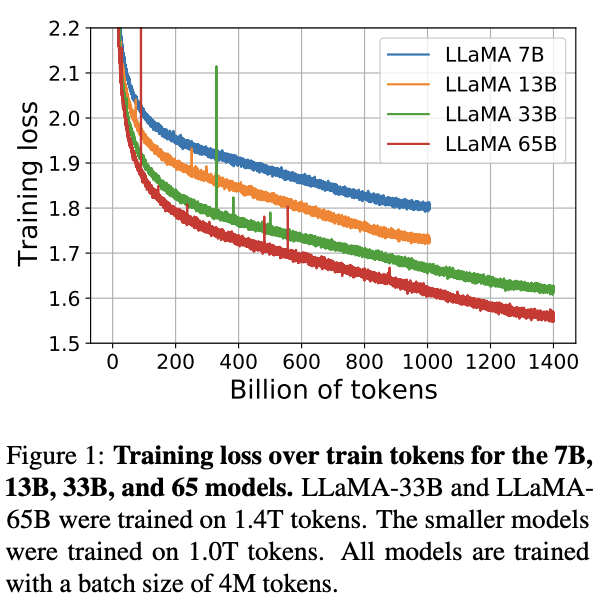

- 1T tokens 학습(pic 3에서 1T 토큰 이상으로도 7B 모델 성능 개선)

- Pre-normalization(GPT-3), SwiGLU 활성함수(PaLM), Rotary Embeddings(GPT-Neo) 방식에 바탕

- 친칠라나 PaLM, GPT-3의 불투명성 대비 LLaMA는 Open-source 데이터(CC, C4, Wikipedia 등) 만 사용하여 모델 공개

- 다만 상업용 및 생산 목적(?)으로는 모델과 데이터 사용 불가

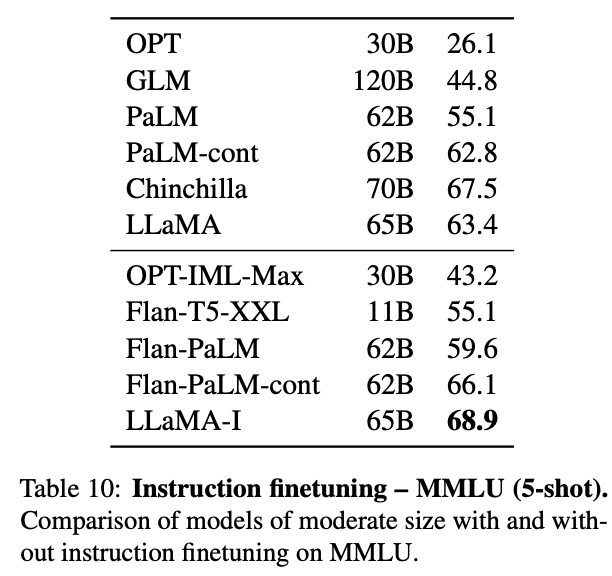

- instruction finetuning도 시도했다고.(pic 4)