Larger language models do in-context learning differently

Meta info.

- Authors: Jerry Wei, Jason Wei, Yi Tay

- Paper: https://arxiv.org/abs/2303.03846

- Affiliation: Google Research, Stanford Univ.

TL; DR

충분히 큰 LLM은 사전학습과 배척되는 label이 주어지더라도, 사전학습 내용을 덮어두고 새로 주어진 label로 override 할 수 있음. 이 뿐만 아니라 충분히 큰 LLM은 label을 의미적으로 관련 없는 label로 대체해도 성능이 나옴.

Suggestions

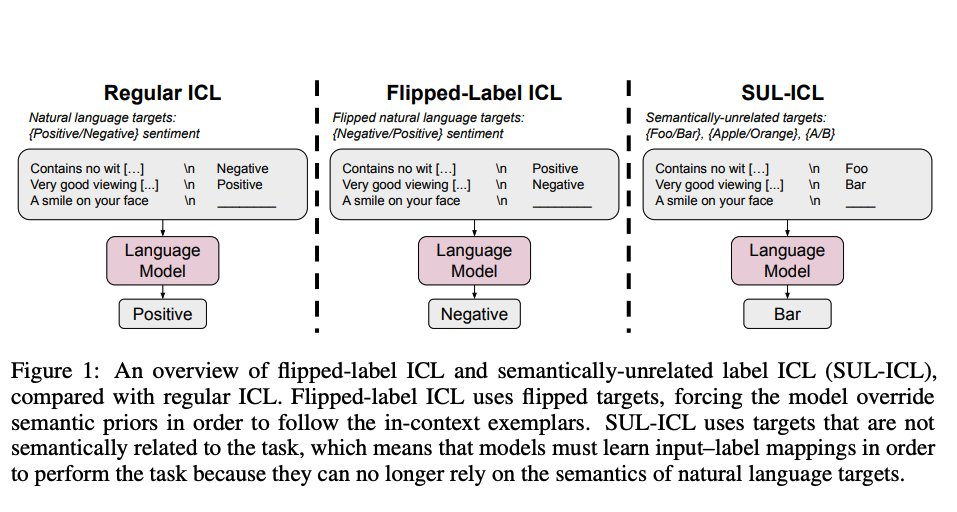

언어모델의 ICL이 input-label 매핑과 semantic priors에 어떻게 영향을 받는지에 대해 1) flipped label 2) semantically unrelated label 두 가지의 ICL setting에 대한 조사 진행. (pic 1)

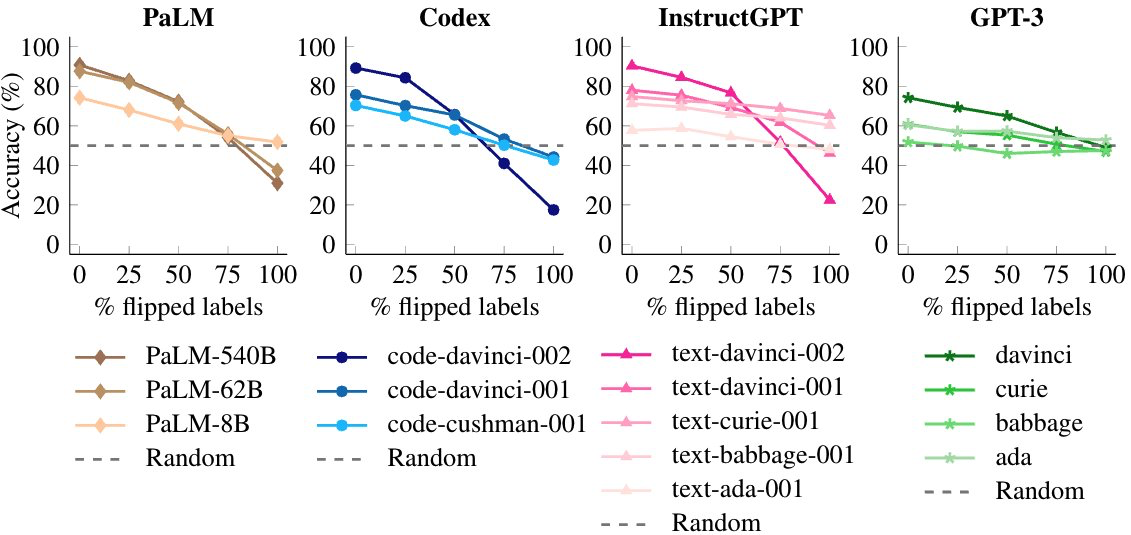

- flipped label ICL 실험: LLM(GPT-3.5, PaLM 등)에서만 semantic priors override가 기능함.

- 만약 pretrain에서 배운 내용(지식)과 모순되는 내용이 context로 나타나면, 작은 모델은 context에 등장한 모순된 내용(flipped label)을 무시하고 pretrain에서 배운 내용(지식, 논문에서는 semantic priors)에 의존하는데

- 큰 모델은 (언뜻 생각하면 더욱 그 경향성이 뚜렷할 것 같으나) pretrain에서 배운 priors(지식)와 모순되는 context(exampler)가 제시되면 그 priors를 무시하고 exampler로부터 배울 수 있었음. (pic 2)

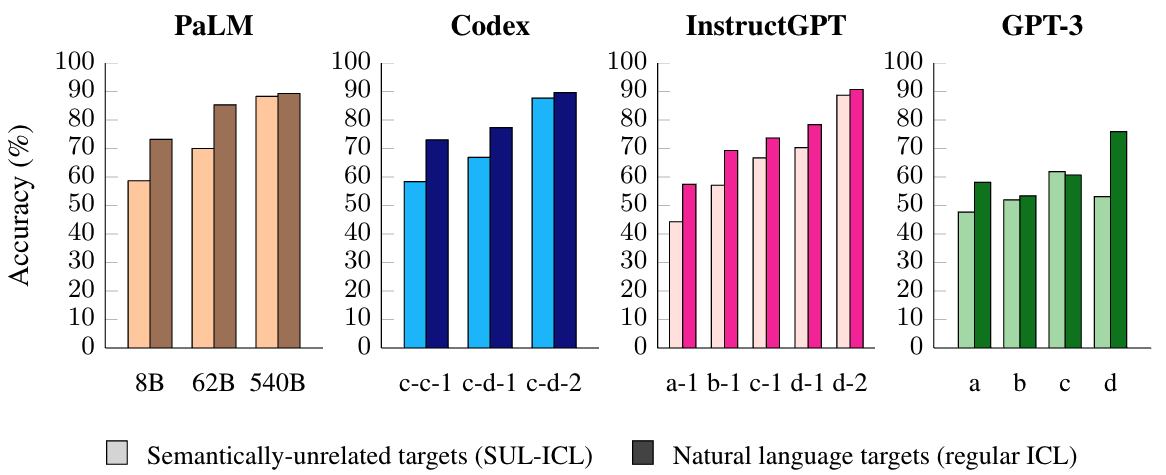

- semantically unrelated label(SUL-ICL) 실험: context에 제시된 서로 의미적으로 아무 연관이 없는 input-label 매핑을 강제로 학습 (e.g. neg/pos 를 foo/bar로 대신함)하는 실험

- 실제 모델 규모가 충분히 큰 경우 linear classification까지 가능. (pic 3)

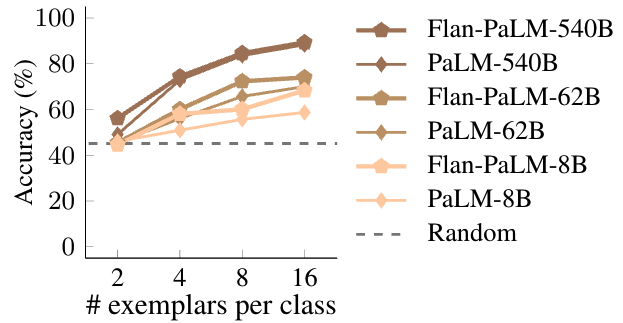

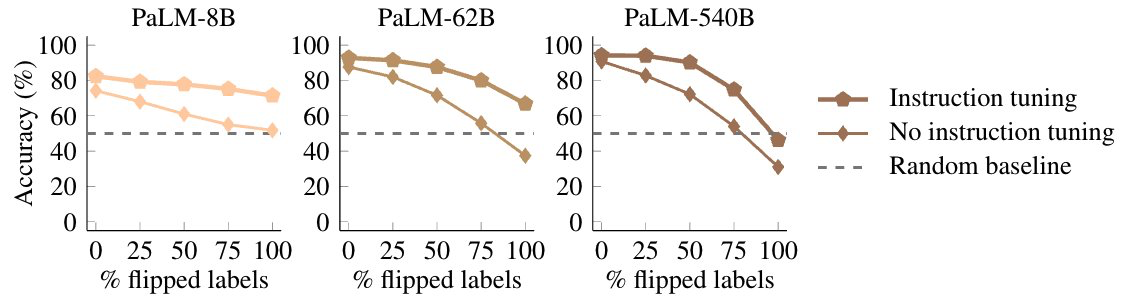

- instruction-tuning 실험: instruction-tuned 모델을 평가한 결과, semantic priors 사용과 input-label 매핑 학습 능력을 모두 강화하나, 전자에 더 많은 영향을 미치는 것을 확인

- 논문의 실험을 예로 들면, 2) SUL-ICL 실험에서 Flan-PaLM(instruction-tuned 모델)은 PaLM보다 성능이 우수하나(pic 4)

- 반대로 1) flipped label 실험에서는 PaLM이 Flan-PaLM보다 나았음(pic 5)

- 즉, instruction tuning은 실제로 사용가능하다면 semantic priors의 사용을 강화하는 듯.

Personal note. 이런 연구들을 볼때마다 label verbalization이나 prompt의 표현 방식에 대한 탐구가 LLM에서는 그렇게 의미를 가지지 않을 수도 있다는 생각.. ICL 좀 막연하게 생각했었는데 지난번에 리뷰했던 논문들의 연장으로 듬성듬성 훑었는데 어렵지만 흥미롭고 label verbalization이나 prompt의 표현 방식에 대한 탐구는 prompt engineering이라는 이름으로 이미 사람들이 할만큼 한 것 같습니다