LLaMA Pro: Progressive LLaMA with Block Expansion

Meta info.

- Authors: Chengyue Wu, Yukang Gan, Yixiao Ge, Zeyu Lu, Jiahao Wang, Ye Feng, Ping Luo, Ying Shan

- Paper: https://arxiv.org/pdf/2401.02415.pdf

- Affiliation: Tencent AI

TL; DR

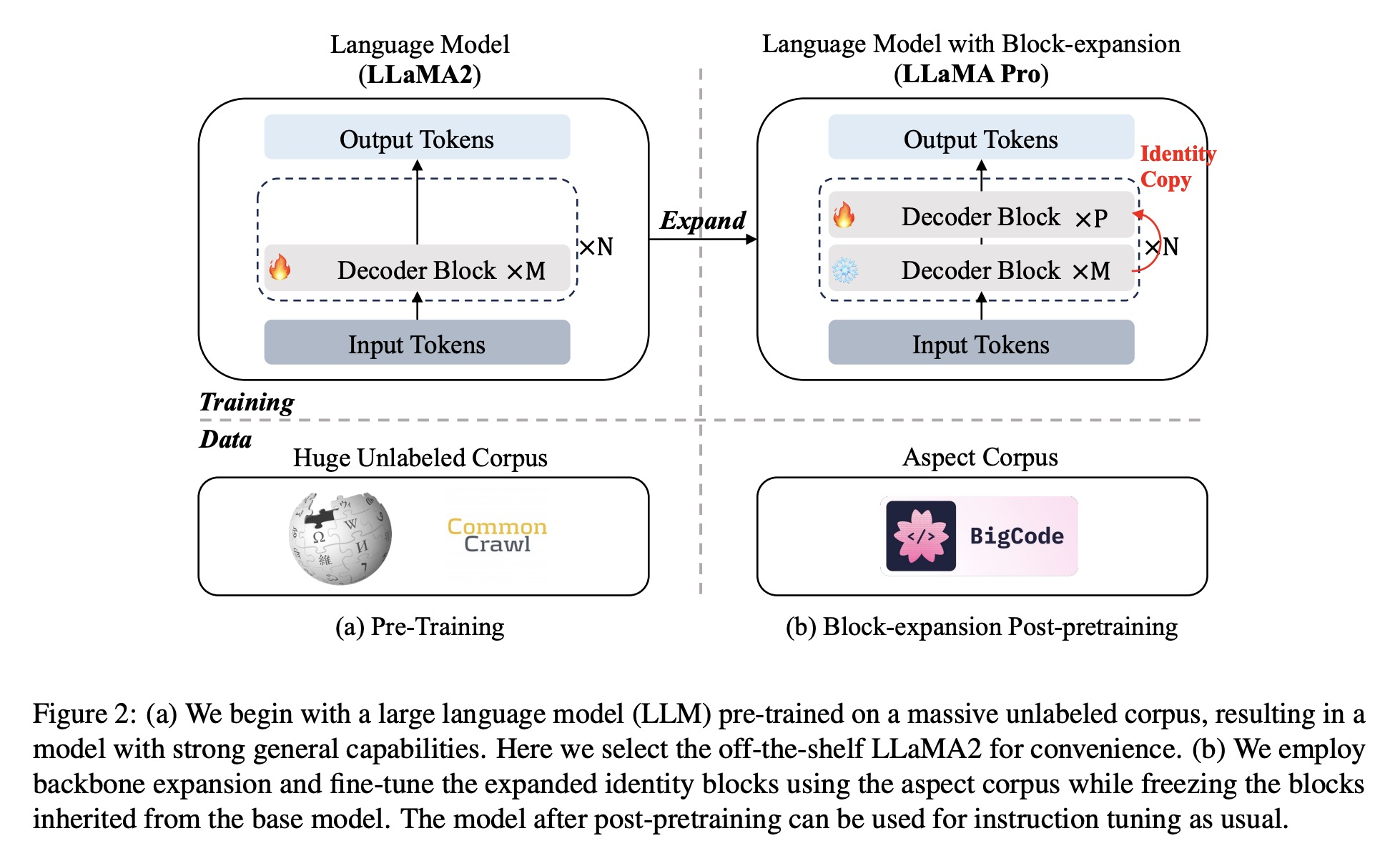

새로 추가한 블록의 매개변수만 도메인 데이터로 업데이트하는 post-pretraining 방식의 block expansion이 domain-specific task에 특히 유용하다고 제안. 전체를 finetuning할 때 발생되는 망각이 일어나지 않는다고. 동일 데이터 사용을 전제했을 때 LLaMA2 보다 일관되게 outperform, 특히 expansion 과정에서 더 많은 지식을 습득한다고. 다만 지적된 바와 같이 블록 수를 task 별로 조정해야하는 것은 한계.

LLaMA Pro: Progressive LLaMA with Block Expansion

Suggestions

- P=1, M=4, N=3으로 실험(pic2 변수 참고), LLaMA2-7B 모델의 32블록에서 40개로 확장, 즉 각 그룹(?)이 4블록에서 5블록으로 확장.

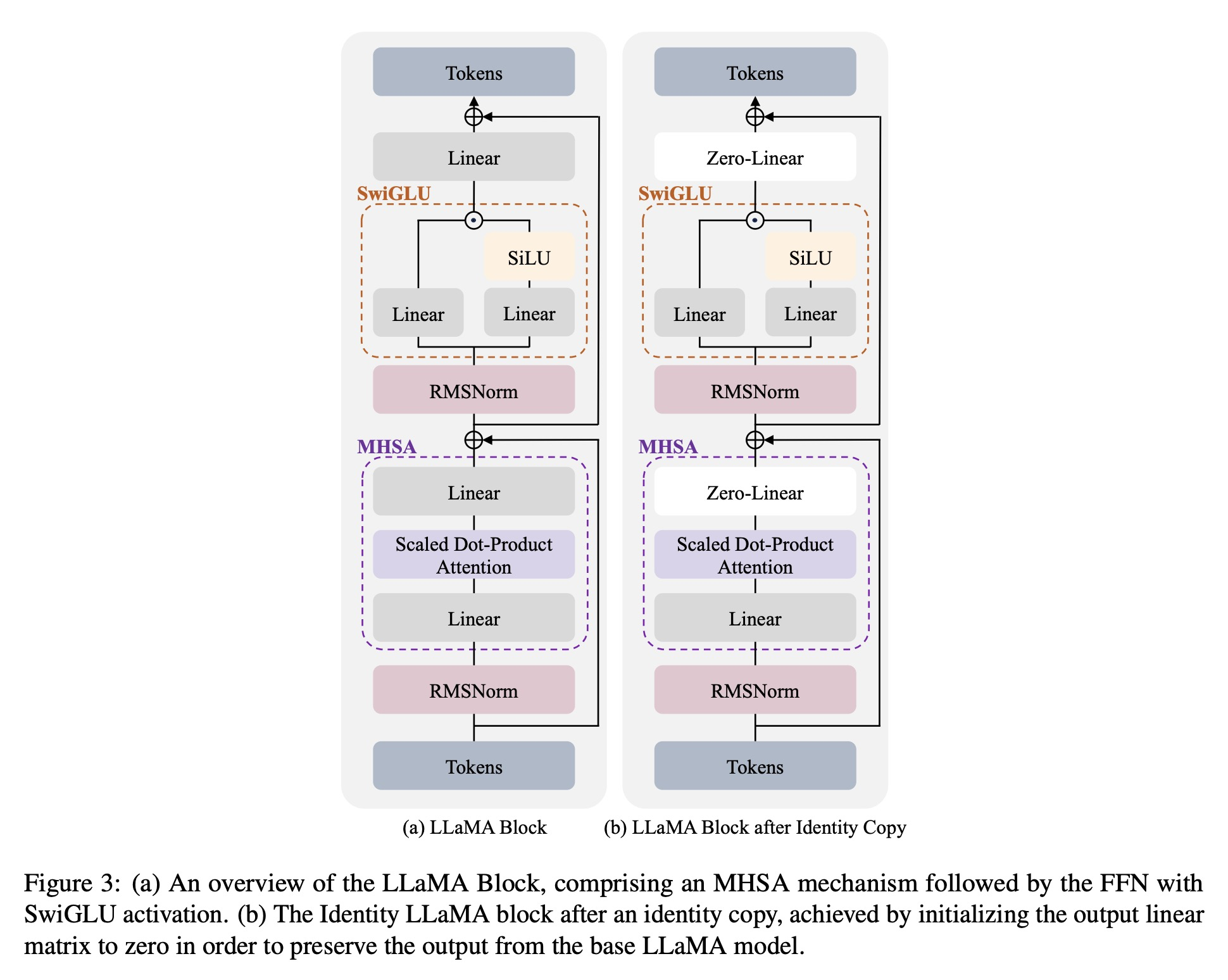

- identity block: 원래 모델의 block copy & insert하는 과정에서 확장된 block. 블록 내 multi-head self-attention & FFN가 input의 RMSNorm을 취할 때 0을 출력하도록 initialize(by-pass)

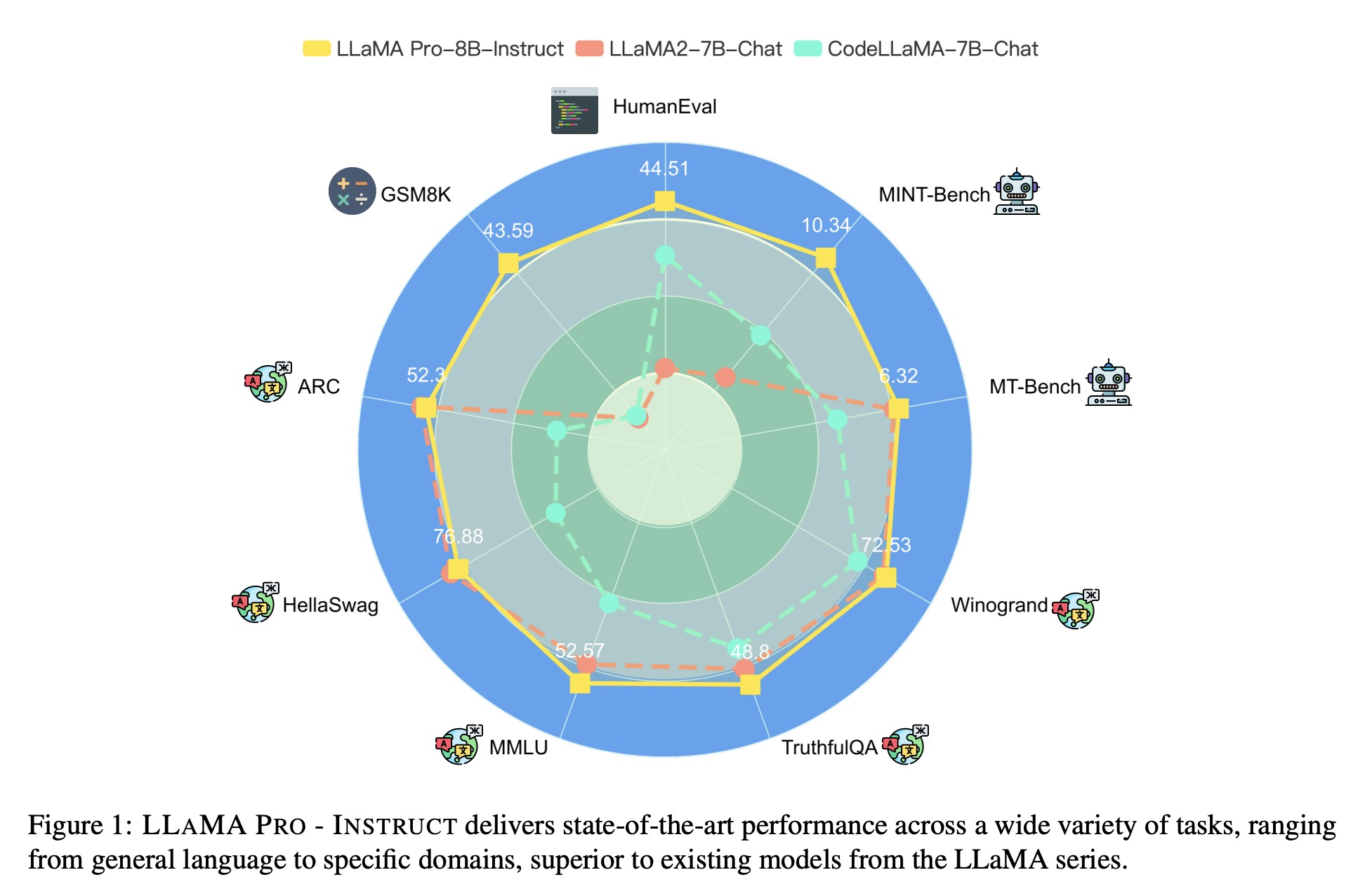

- code task 처럼 전문 용어 혹은 특수 domain에 적용시 유리 (pic1)

Personal note. 업스테이지 모델과 큰 맥락은 비슷한 것 같은데 (모델을 어떻게 효과적으로 잘 늘릴지?)