Should We Respect LLMs? A Cross-Lingual Study on the Influence of Prompt Politeness on LLM Performance

Meta info.

- Authors: Ziqi Yin, Hao Wang, Kaito Horio, Daisuke Kawahara, Satoshi Sekine

- Paper: https://arxiv.org/pdf/2402.14531.pdf

- Affiliation: RIKEN AIP, Waseda Univ.

- Published: March 22, 2024

TL; DR

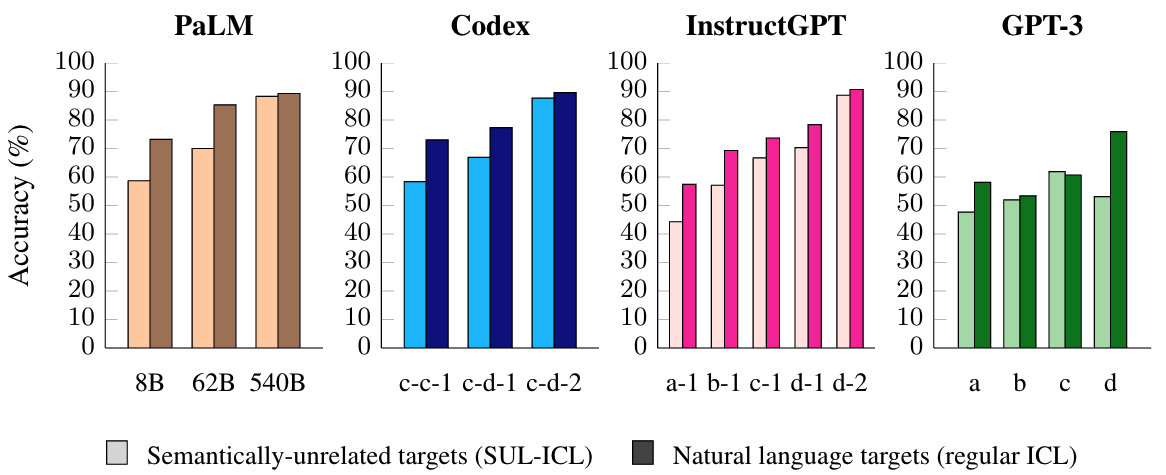

LLM에게 적당히 예의바르게 쿼리하면 더 좋은 성능이 나온다는 empirical study.

Suggestions

- 영어, 중국어, 일본어에 대해 확인한 연구

- 공손한 수준을 8개로 나눠 정의하고 각 수준에 따라 벤치마크 성능을 확인한 결과, 경향적으로 공손한 프롬프트에 더 답변을 잘하는 것으로 보이며, 무례할 경우 오답이나 답변 거부등이 발생될 수 있었다고.

- 다만 예의 수준이 언어마다 다르다는 점은 고려가 필요하다고 언급.

- 너무 공손하면 오히려 성능이 안좋았다고 하고, 모델 학습 데이터 구성에 이러한 부분을 고려해야겠다는 언급.