Agent-R: Training Language Model Agents to Reflect via Iterative Self-Training

Meta info.

- Authors: Siyu Yuan, Zehui Chen, Zhiheng Xi, Junjie Ye, Zhengyin Du, Jiecao Chen

- Paper: https://arxiv.org/pdf/2501.11425

- Affiliation: ByteDance Seed, Fudan Univ.

- Published: January 20, 2025

- Code: https://github.com/bytedance/Agent-R

TL; DR

Multi-turn 환경에서 LLM self-reflection & correction 강화 framework Agent-R 제안

Background

LLM Agent에 대한 기대가 높아지지만, 아직 한계점 산재

Problem States

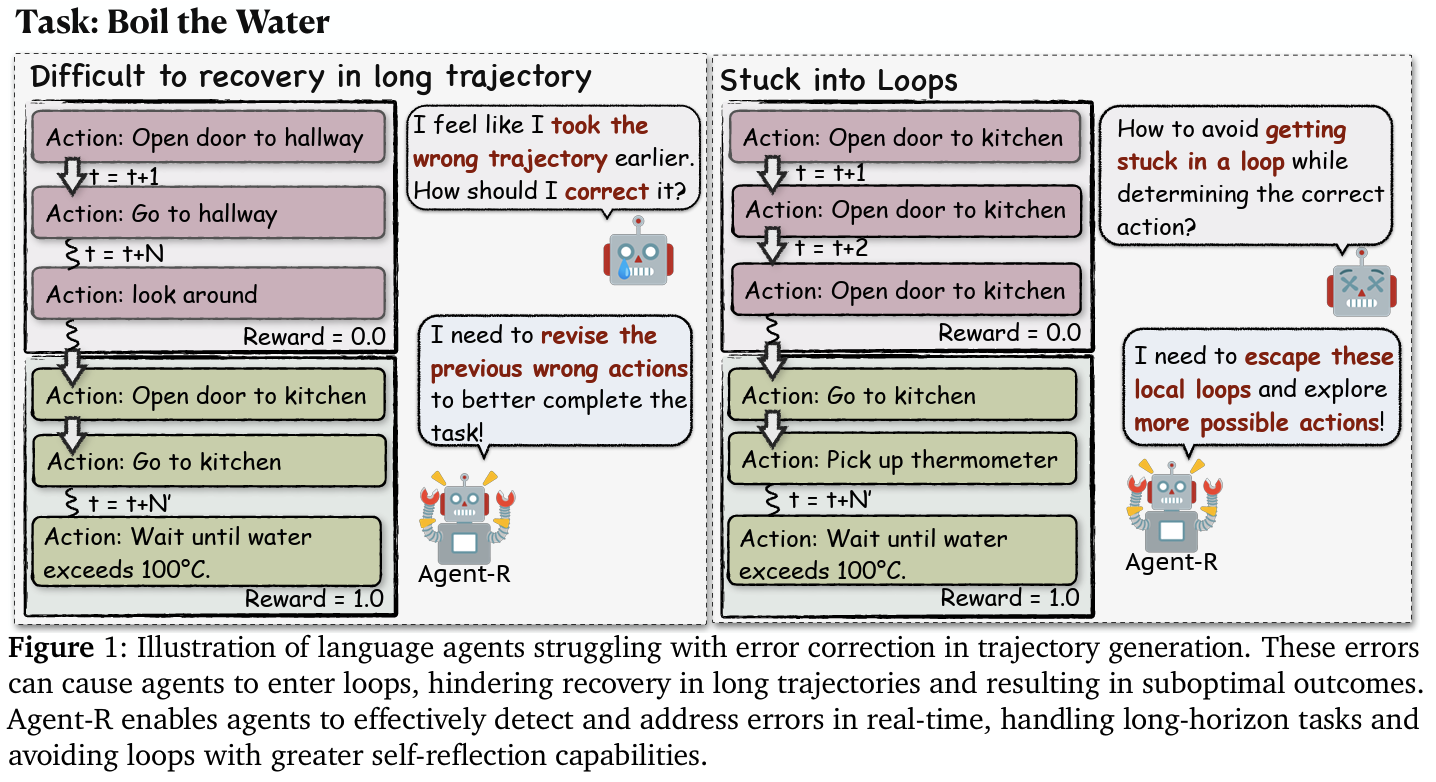

- 오류 수정 못함: 기존의 strong 모델의 행동(expert trajectories)을 복제하는 것을 기반으로하는 학습은 오류 수정이나 path 수정을 가능하게하지는 못함

- real-time 수정 못함: single-turn 중심이고 실행 완료 후 (대화 종료 후) feedback이 명시적이게 (코드 실행 후 오류메세지) 제공되는 게 아니면 수정할 방법이 없는 편 → 오류 누적

- 심하면 loop에 빠져서 못나옴 - **Research question:** 실시간 + 멀티턴 환경에서 수정할 수 있는 agent framework 개발

Suggestion

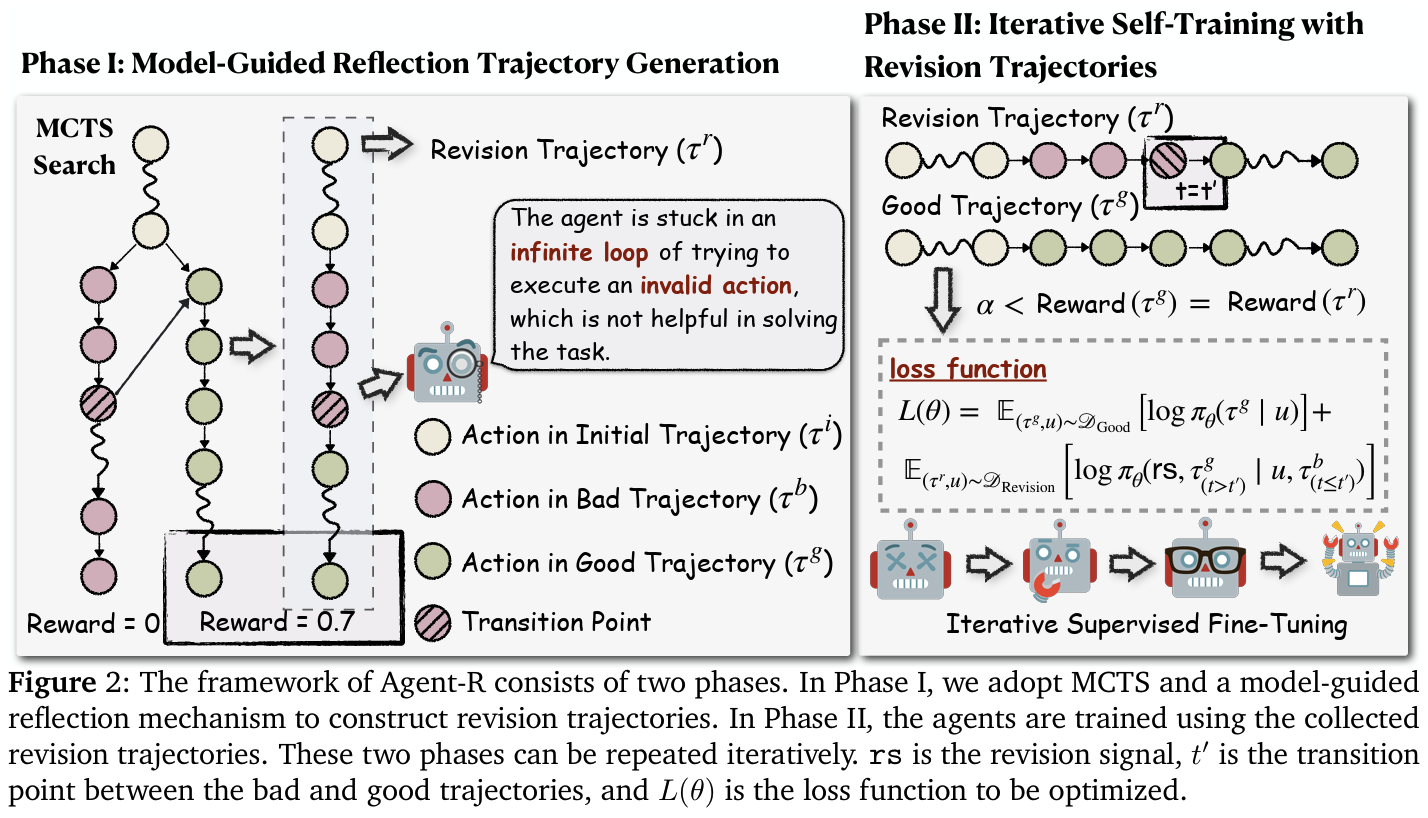

Iterative Self-Training

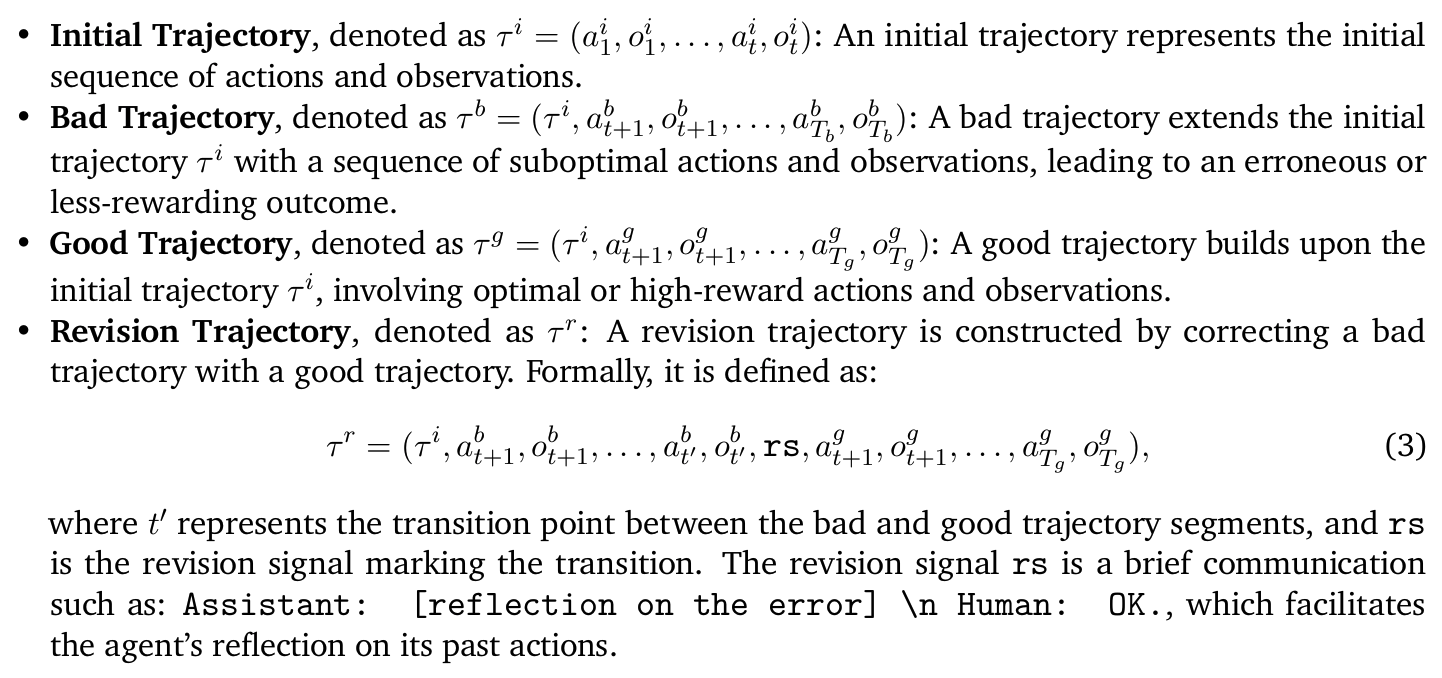

- Reflection Trajectory을 위한 4가지 trajectory type 정의: initial, bad, good, revision trajectory

- phrase 1: MCTS로 가능한 trajectory 탐색 > 식별된 전환 지점에서 bad trajectory (오류인 trajectory)랑 good trajectory 연결 (수정) = correction path 구성 (Step-Level Reflection Dataset)

- phrase 2: phrase 1에서 생성한 trajectory를 모델이 RL 학습= 오류 식별 및 수정 배우도록 - **Experiments:**

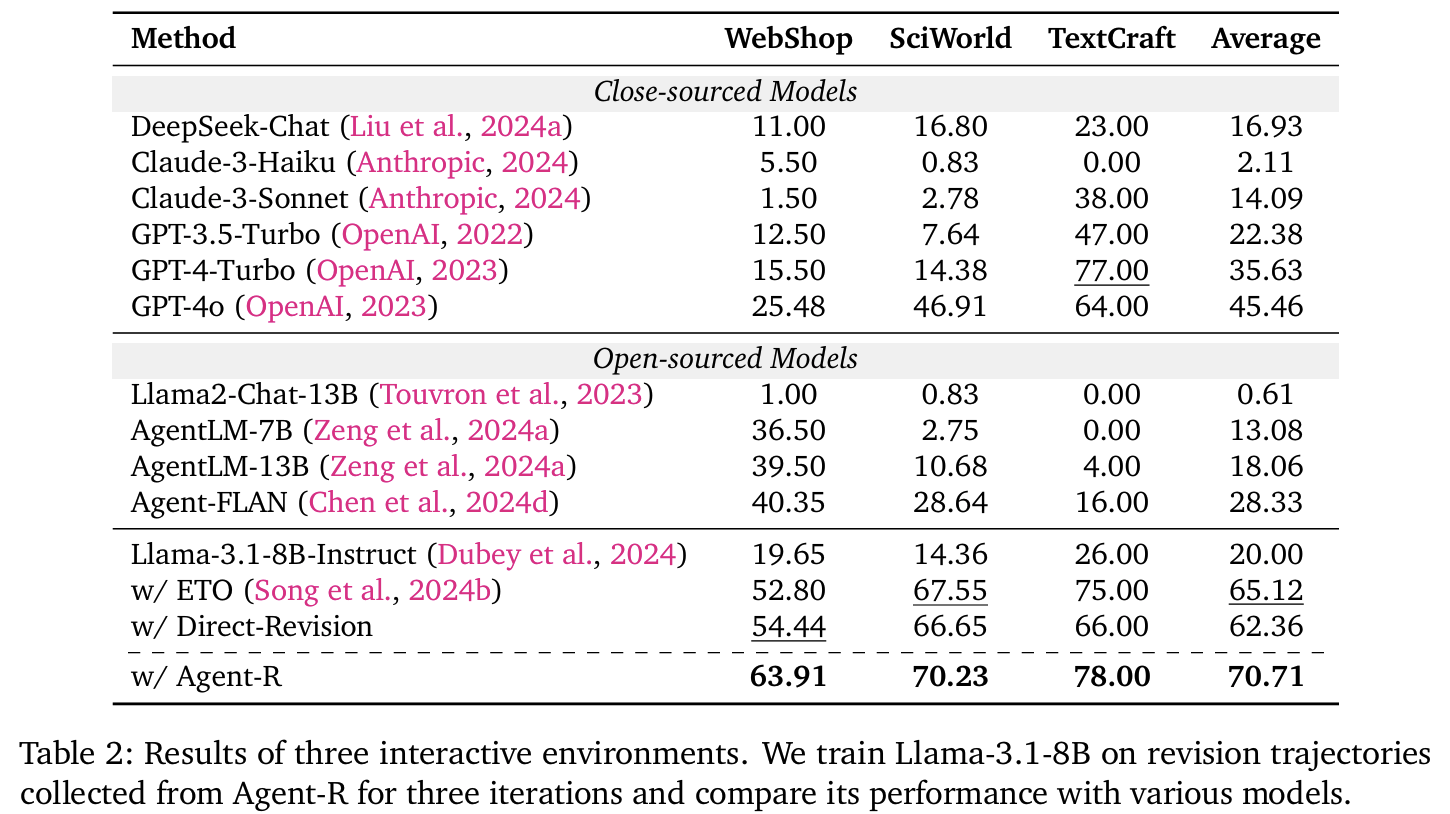

- `Table 2` - Main Table

- Tasks: WebShop, SciWorld, TextCraft - Agent 환경에서 벤치마크

- metrics: 최종 리워드나 성공률 등

- results: Agent-R이 모든 환경에서 SOTA

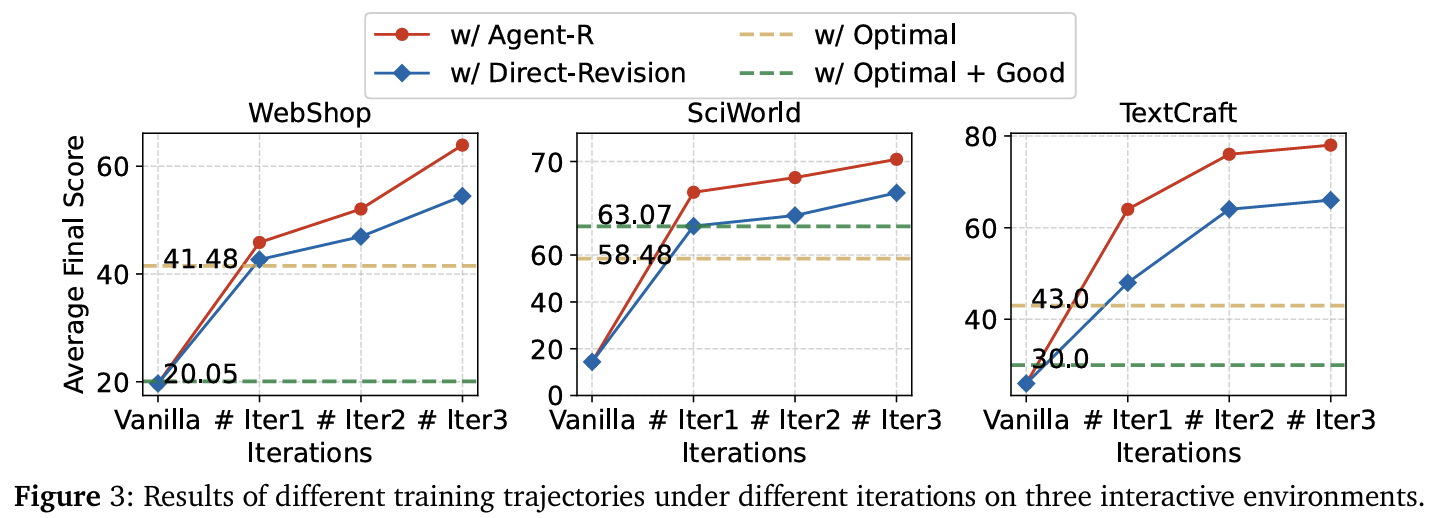

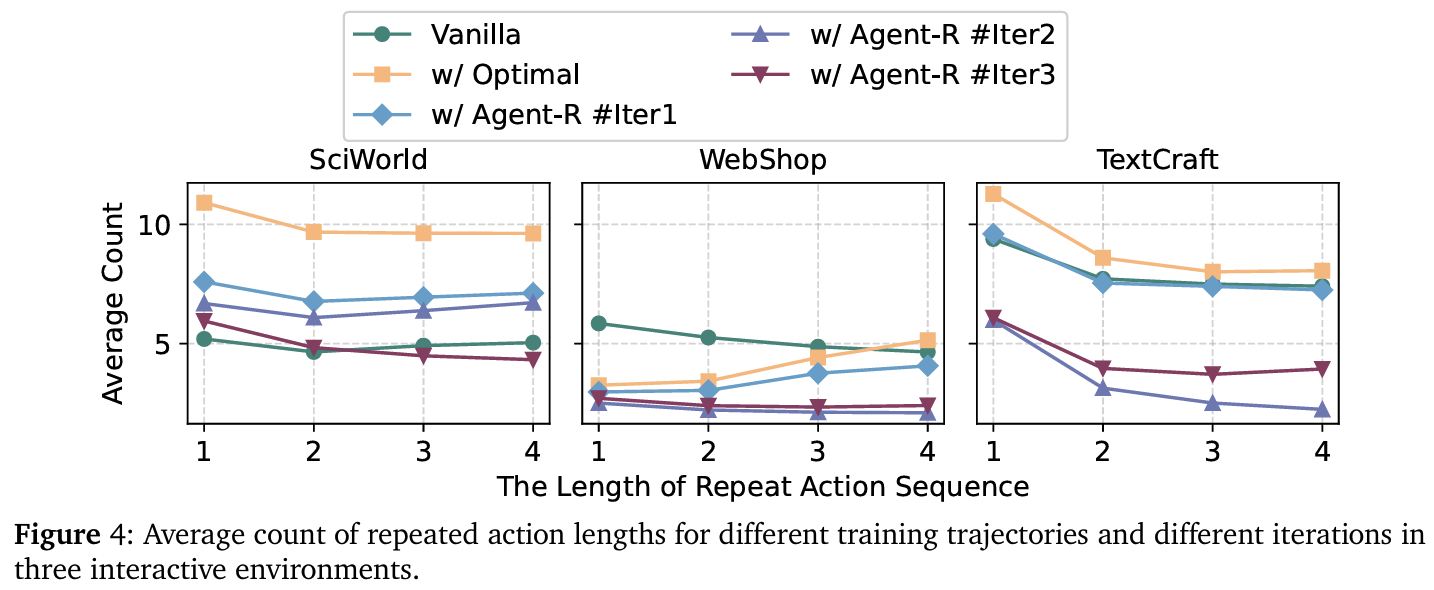

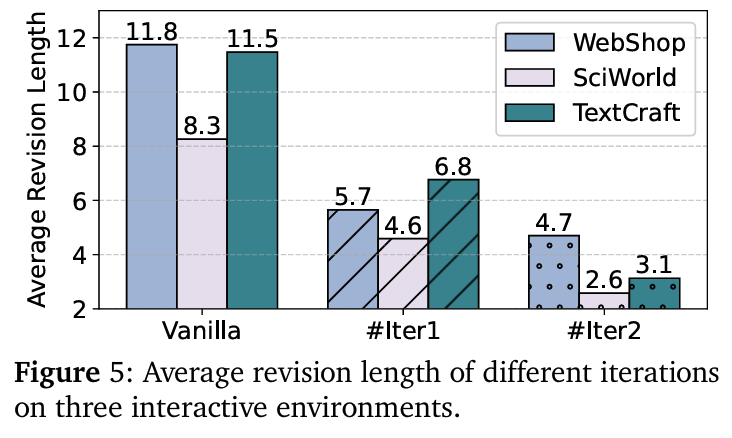

- `Figure 3, 4, 5` - iterative training 관련

- 각 iteration 에서 Agent-R과 다른 baseline 비교

- results: 학습 반복되면서 성능이 꾸준히 향상 (iter=3이 최대) + loop 빠지는 빈도 현저히 감소 + Revision length도 짧아짐

Personal note.

전에 multi-turn preference 이야기하면서 생각했던 내용들을 ToD Chitchat 전환 문제 먼저 풀겠다고 잠시 미뤄뒀는데, 관련 연구가 자꾸 나오면서 애꿎은 손톱 뜯습니다,,,Loop 빠진다는 내용은 팀원이 화요일에 발표해준 논문에서도 언급되었던 agent의 주요 실패 요인이고, multi-turn 환경을 고려하고자 하는 노력은 제가 금주 발표드린 논문과 맥을 같이 합니다. 풀이 방식도 비슷..