LIMO - Less is More for Reasoning

Meta info.

- Authors: Yixin Ye, Zhen Huang, Yang Xiao, Ethan Chern, Shijie Xia, Pengfei Liu

- Paper: https://arxiv.org/pdf/2502.03387

- Affiliation: GAIR

- Published: February 5, 2025

- Code: https://github.com/GAIR-NLP/LIMO

TL; DR

작지만 좋은 데이터만으로 수리추론 능력 향상시키기 = 모델이 이미 알고 있는 걸 잘 끄집어내는 것이 중요하다.

Background

고급 수리추론을 위해서는 약 수십만 예제가 필요하다는 통념 + RL or scaling 위주

Problem States

대규모 데이터 없이 LLM에 복잡한 수리 추론 능력을 향상시킬 수 있을까?

- SFT가 단순 암기를 하는걸까?

- 지난 LIMA (Zhou et al. 2024) 처럼 상대적으로 작지만 품질 좋은 데이터를 통해 alignment가 가능하다는 연구의 수리추론 적용 가능성에 대한 연구 미비

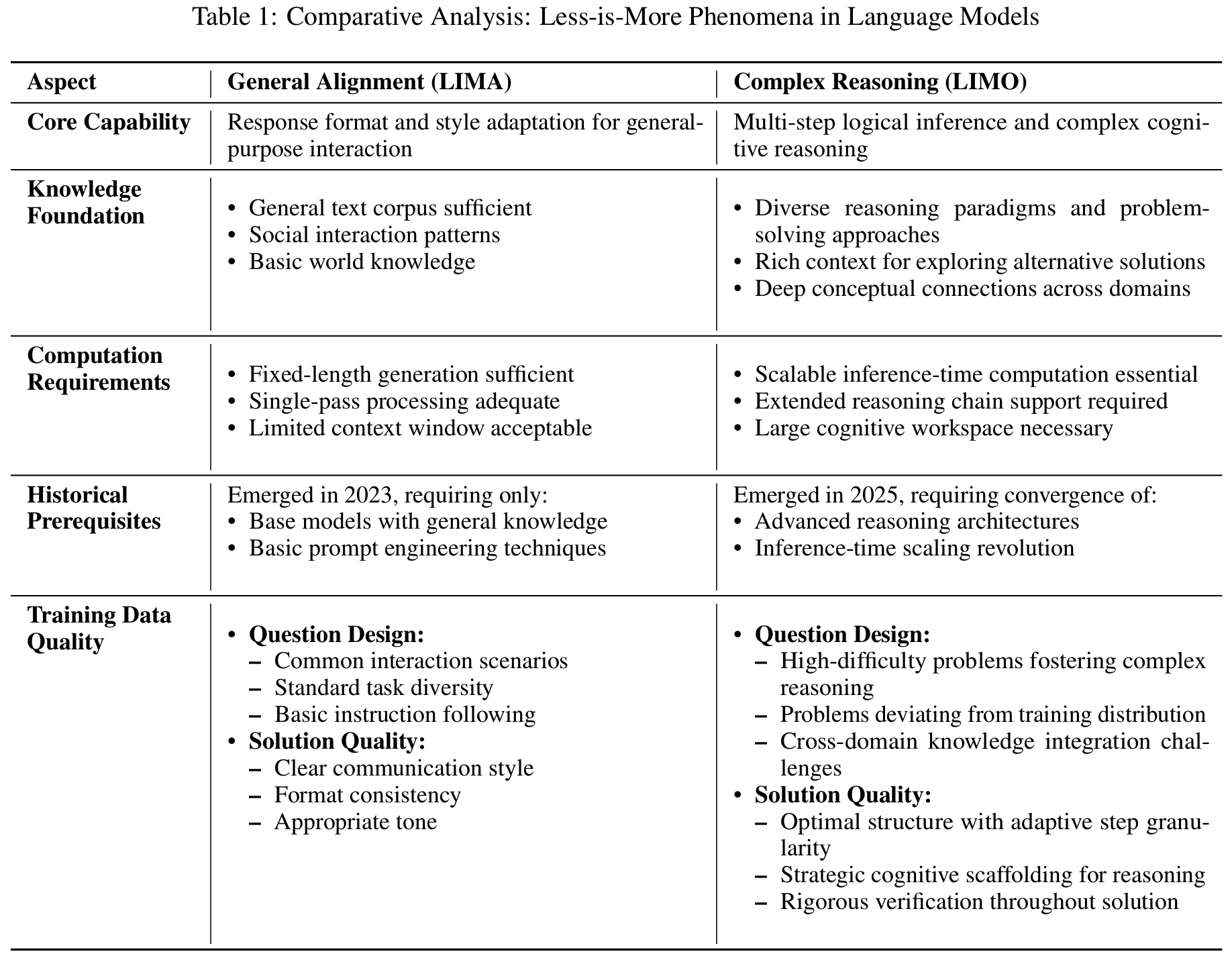

Tab1

Suggestions

Less-Is-More Reasoning Hypothesisa

- 가설: LLM이 충분한 사전 훈련 데이터를 가지고 있다면, 소량의 고품질 예제만으로도 고차원 추론 능력을 활성화할 수 있다.

- 모델이 사전 훈련 과정에서 충분한 도메인 지식을 내재하고 있어야 한다.

- 적은 양이더라도 최적의 예제를 추려주면 추론 능력을 효과적으로 향상할 수 있다.

- L5 (good) ~ L1 (poor): 품질은 인간 전문가가 보고 llm 기반 필터링 수행

- LIMO setup

- backbone: Qwen2.5-32B-Instruct

- SFT datasets: 817개의 고품질 수학 문제 데이터셋 추리기

Effects

- Experiment setup

- Task: AIME24, MATH500, OlympiadBench, GPQA, …..

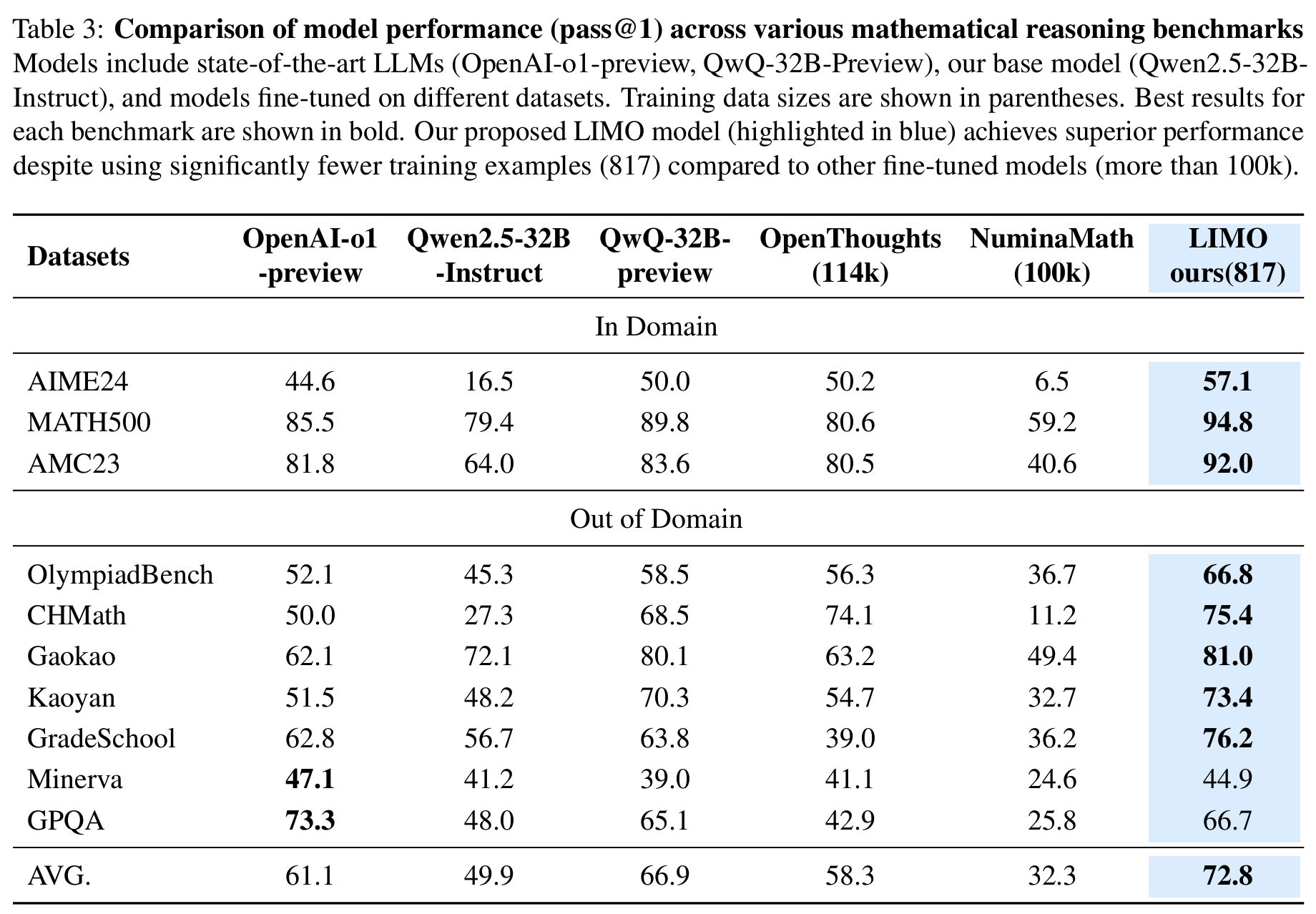

- 비교 모델: OpenAI-o1-preview, QwQ-32B-Preview, NuminaMath (100K 샘플), OpenThoughts (114K 샘플)

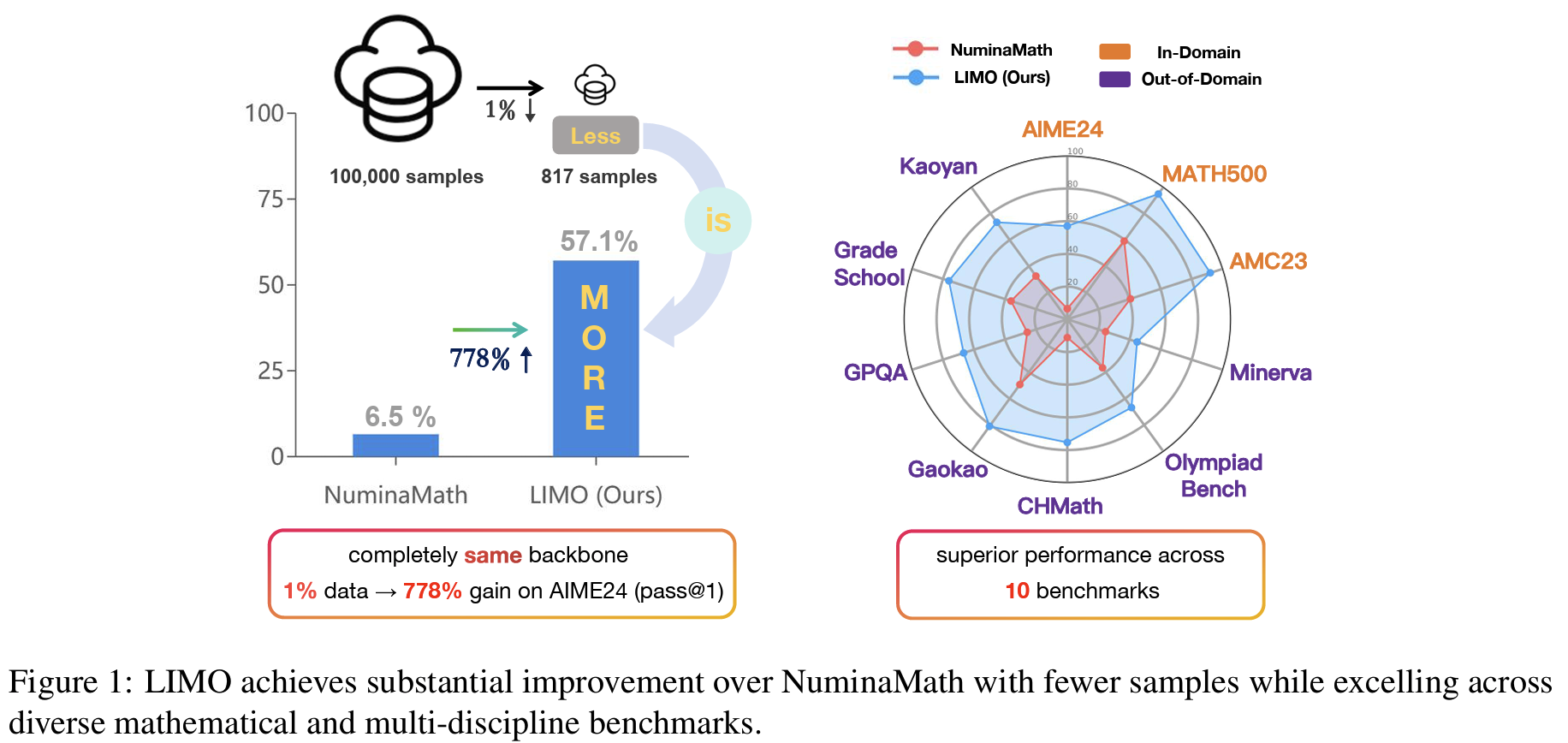

- results: LIMO 모델이 기존 SFT 모델보다 좋은 성능 달성

- 단 817개만 썼는데 대규모 데이터셋(100K+)로 학습한 모델보다 우수한 성능

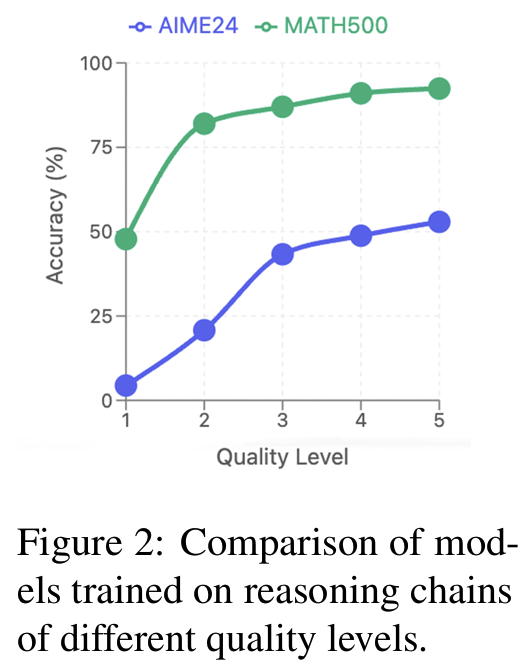

Tab3 - RQ1 reasoning chain quality (풀이 품질):좋은 품질의 풀이 과정을 배울수록 성능 향상 확인

Fig2- L5 (최고품질) 데이터셋으로 학습한 모델이 L1(최저 품질) 학습한 것 대비 AIME에서 15%p, MATH500에서 12%p까지 높은 성능

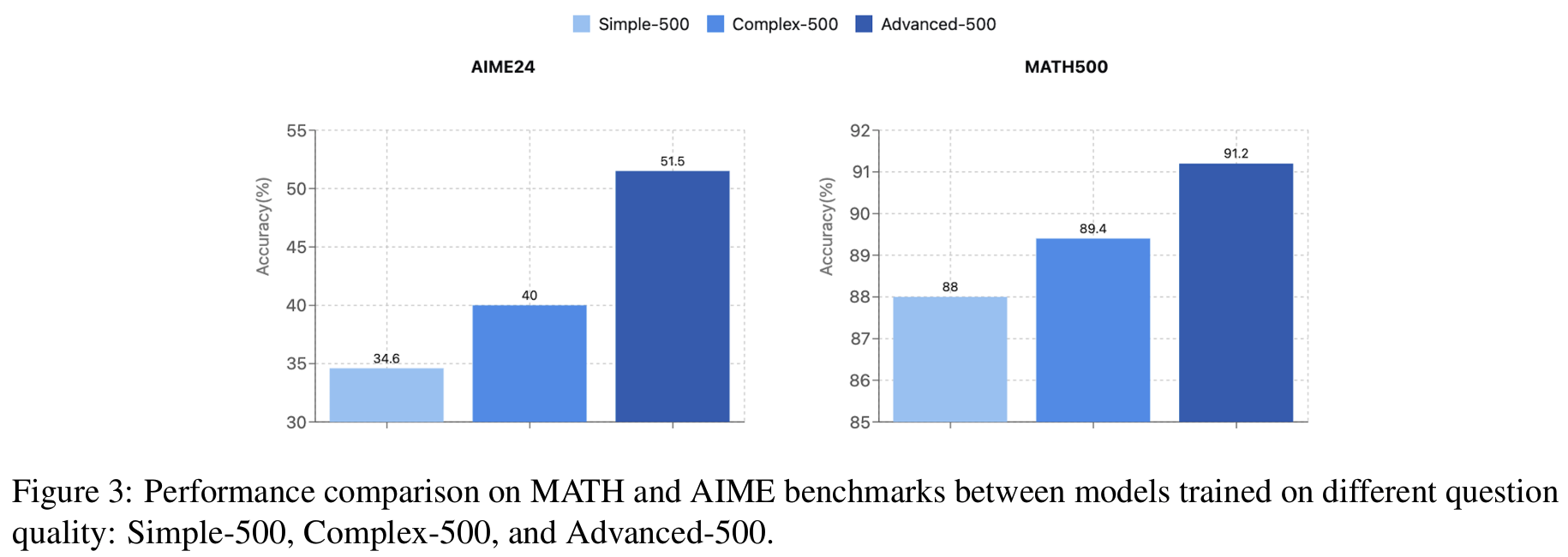

- RQ2 question quality (문제 품질): 쉬운문제보다 어려운 문제 배울 때 모델 일반화 성능 향상

Fig3- AIME24에서 simple500 학습시 35%, advanced500 학습시 51.5% 달성

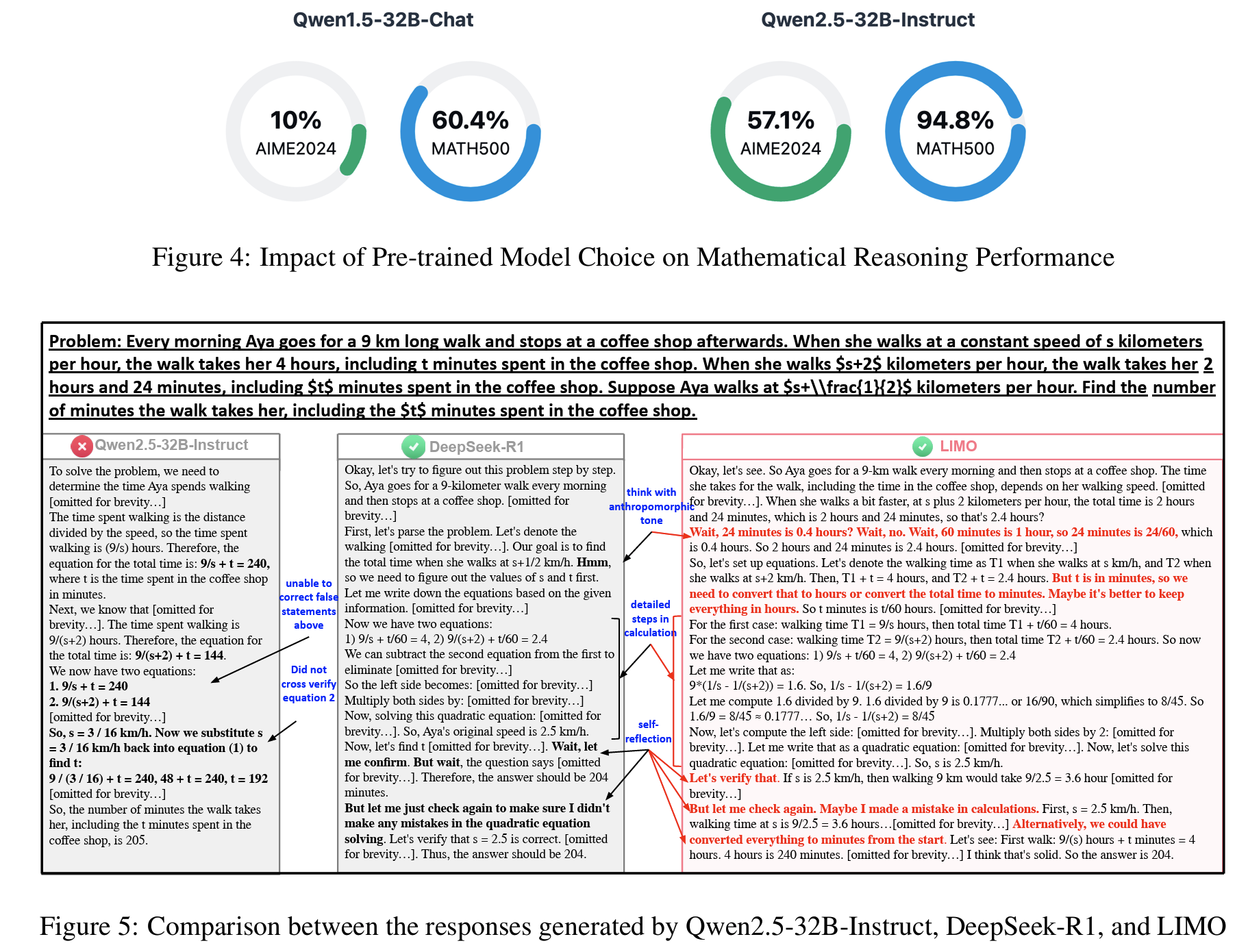

- RQ3 LLM backbone (PTM): backbone이 좋을수록 성능 향상

Fig4- AIME24에서 Qwen2.5-32B-Instruct > Qwen1.5-32B-Chat 대비 47.1%p 향상

- CASE STUDY

Fig5: LIMO하면 self-reflection 하기도 했다고당연히 그런 데이터를 남겨서 학습시켰으니..(Wait, let me check again, …)

- 단 817개만 썼는데 대규모 데이터셋(100K+)로 학습한 모델보다 우수한 성능

Personal note. meta에서 나왔던 LIMA의 주장을 뒷받침하는 후속 논문들이 계속 나오고 있는데, 의의는 항상 비슷하게 데이터 품질에 대한 강조로 수렴하는 것 같습니다. AI-gen 데이터가 결국 garbage in garbage out하게 된다는 점을 경계되어야 할 것 같긴 한데, 문제라면 아직은 고품질 데이터를 만드는 데 혹은 거르는 데에 비용이 작지 않다는 점 같습니다.