Reasoning Models Can Be Effective Without Thinking

Meta info.

- Authors: Wenjie Ma, Jingxuan He, Charlie Snell, Tyler Griggs, Sewon Min, Matei Zaharia

- Paper: https://www.arxiv.org/pdf/2504.09858

- Affiliation: Allen Institute., UC Berkeley

- Published: April 14, 2025

TL; DR

reasoning 없이 reasoning 성능 내기 - 프롬프트만 바꿔서 짧게 여러 답변 생성시키는게 긴 CoT보다 나을 수 있다.

Background

LLM에 CoT는 필수적

- 단점으로는 상대적으로 비용이 큼

- 최근 연구에서 CoT 최적화나, BoN, MCTS기반 sampling 등 수행

- 어쨌든 “LLM은 thinking 해야된다”가 전제

Problem States

Thinking이 꼭 필요한가? (LLM 추론에서 CoT를 제거할 수 있는가?)

Suggestions

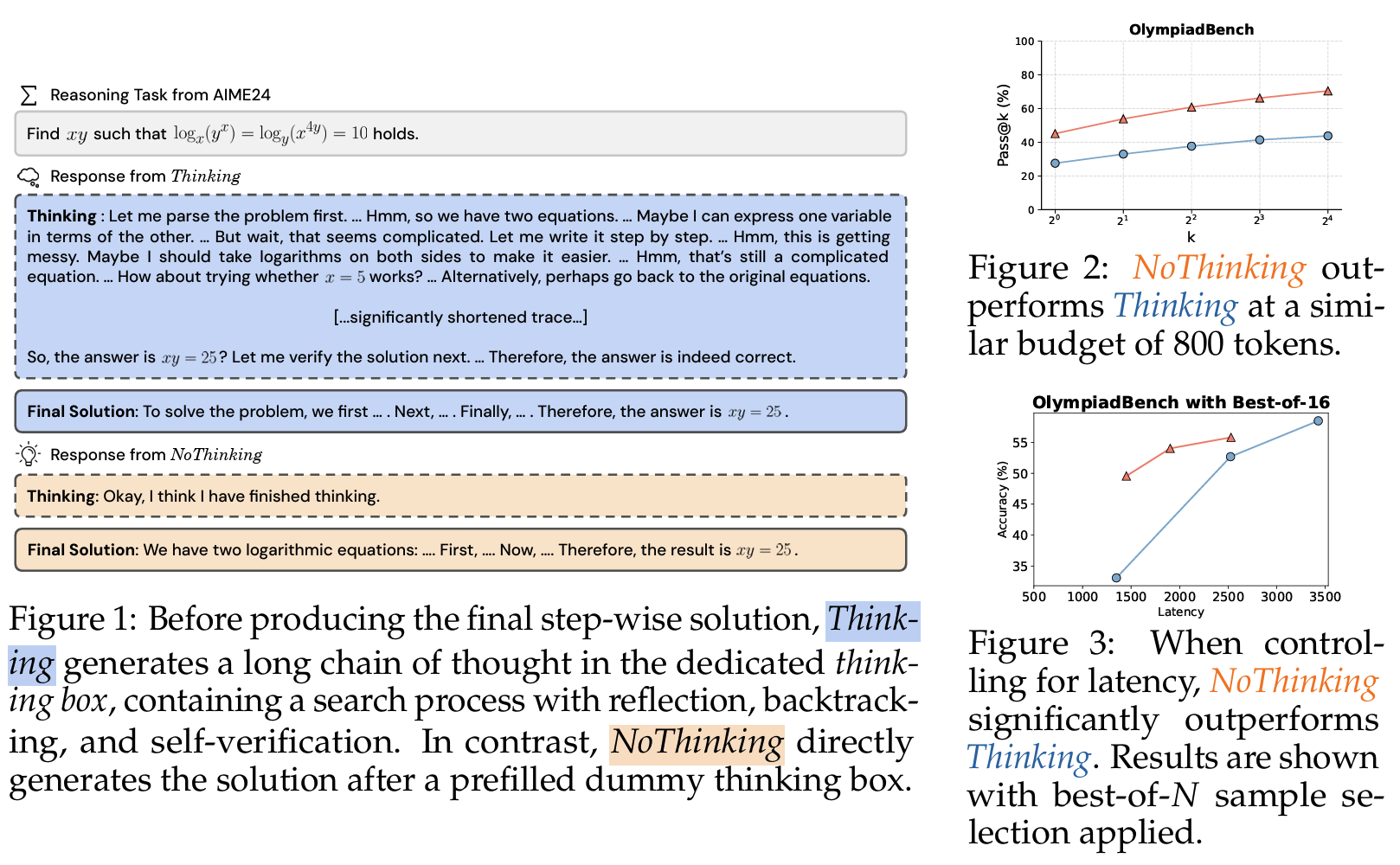

NoThinking

- Thinking: CoT

- NoThinking: 학습은 CoT로 됐더래도 프롬프트 레벨에서 CoT를 시킨 것처럼 처리하기

-

더미의 Thinking box만 두고 바로 최종 답 생성

<|beginning of thinking|> Okay, I have finished thinking. <|end of thinking|>

-

- BoN/Budget forcing 등과 병행

Effects

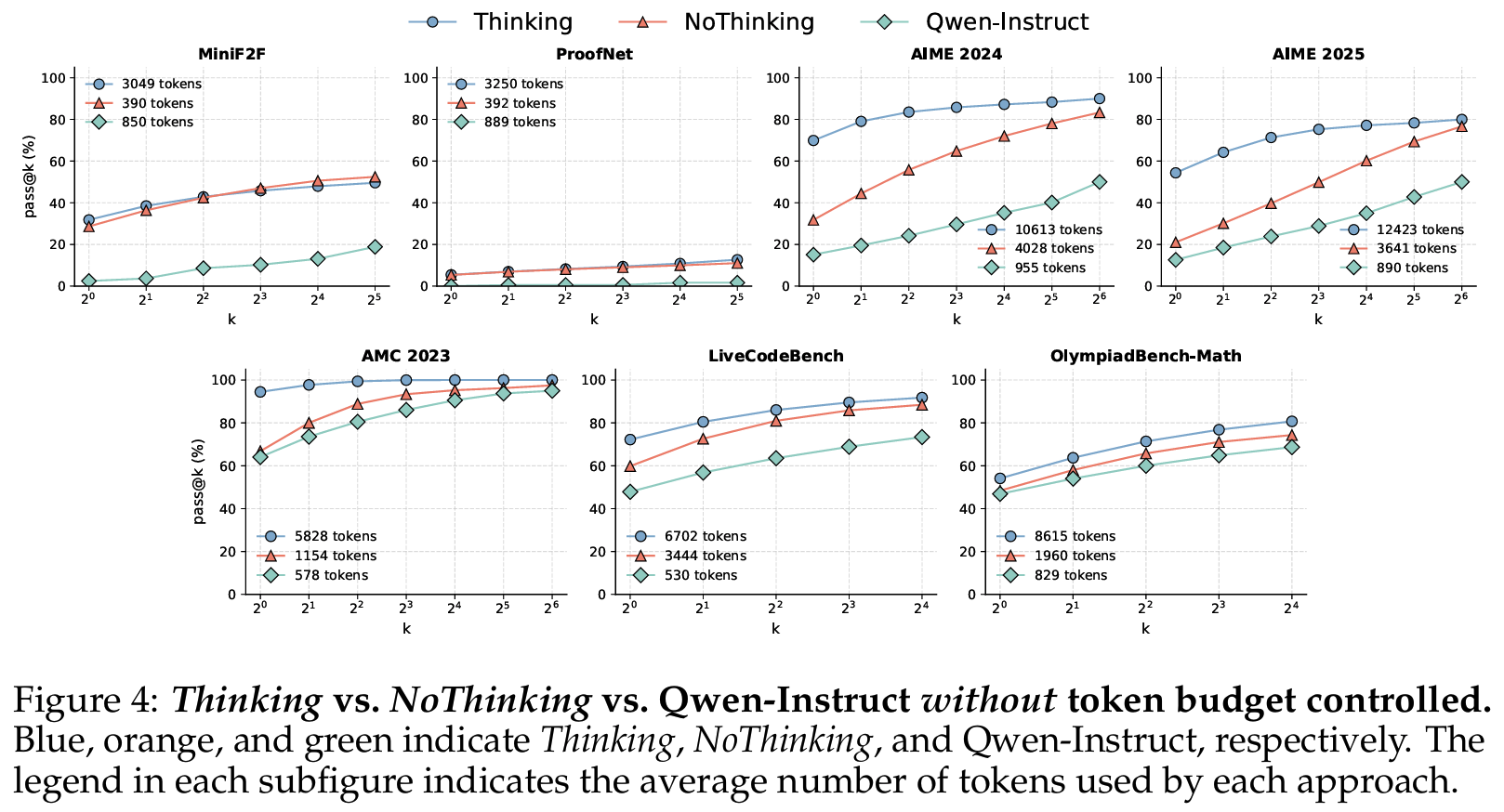

structured reasoning을 안해도 thinking보다 NoThinking이 낫다

- Tasks:

- competitive math (AIME24/25, AMC23, OlympiadBench)

- coding (LiveCodeBench)

- formal theorem proving (MiniF2F, ProofNet)

- competitive math (AIME24/25, AMC23, OlympiadBench)

- Results:

- 대체로 2~5배 더 적은 토큰생성

- 전체적인 성능

- AMC23 (700 tokens): NoThinking이 51.3% vs. Thinking이 28.9%

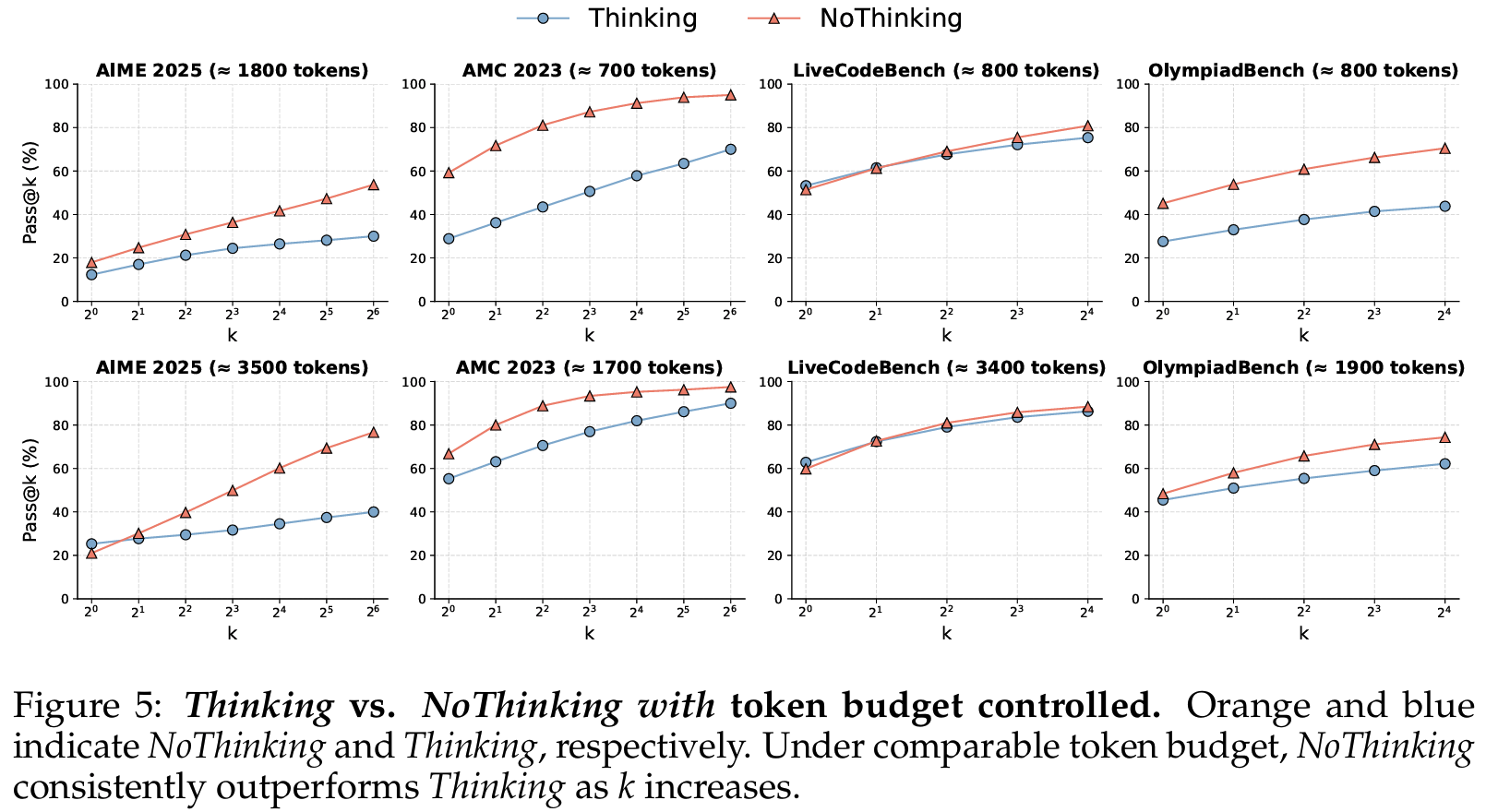

- OlympiadBench (800 tokens): k 키울수록 유익하게 성능향상 (scaling) - 비용면에서 확실한 우위

Fig 2- pass@1에서는 Thinking이 낫기도 하지만..

- (token 제한 없이) NoThinking이 Qwen-Instruct보다 우위거나 대등

Fig 4- LiveCodeBench<-confidence-based방식의 성능이 낮기 때문으로 보임

- parallel-decoding: 기존의 단순 confidence-based나 majoprity voting 적용하면 (훨씬 짧은 latency의) NoThinking+BoN이 pass@1에서 full-Thinkning을 이김

- 최대 9배 빠르고 4배 적은 토큰 생성

- 파레토 최적 달성: NoThinking이 훨씬 낮은 latency에서 높은 정확도

Fig 3

- entropy 기준으로 더 uniform한 다양한 출력 보장 (= pass@k에 유익)