kanana-o modality gap — log-00: 연구 개요 + 실험 설계

Kanana-o Modality Gap Study

Kanana-o(카카오 한국어 특화 omnimodal LLM)에서 입력 모달리티에 따른 성능 갭을 분석하는 소규모 실험 프로젝트.

연구 배경

카카오 옴니모델 kanana-o beta tester로 선정되어, 1일 20회의 API call을 제공받게 되었습니다.

4월 컨텐츠 주제로 이 api 사용 후기를 공유하기로 했는데, 이왕 해보는 거 연구 질문으로 확장해서 국내 학회 제출 가능한 수준의 short paper를 작성해보는 것을 목표로 작은 실험 프로젝트를 수행해보고자 합니다.

Modality Gap 이라는 주제는 물론 제가 현재 연구에 참여하고 있는 방향과도 align 되는 부분이 있기 때문에 익숙하기도 하지만, 무엇보다 4월 2일 진행된 온라인 밋업에서 모델 개발자께서도 관련 개념을 언급하시면서 아직 challenging한 부분이라고 말씀주셨던 게 기억나서 이 방향의 분석이 유익할 것이라고 생각해보게 되었습니다.

모델 개요: Kanana-1.5-o-9.8B

| 항목 | 내용 |

|---|---|

| 개발 | Kakao Multimodal Model Training team |

| 파라미터 | 11.6B (LLM base: kanana-1.5-9.8B) |

| 릴리스 | 2026년 2월 |

| 지식 커트오프 | 2024년 6월 30일 |

| 지원 언어 | 한국어, 영어 |

| 컨텍스트 길이 | 16K tokens |

| 라이선스 | kanana-license |

아키텍처

- 입력: Text / Image / Audio (모든 조합)

- 출력: Text / Audio

- 이미지 인코더 + 오디오 인코더 + 모달리티별 C-abstractor → LLM core → 음성 토큰 디코더

주요 강점

- 한국어 특화: KoNet 벤치마크(CSAT 기반) 89.44점. 동급 모델 중 최고, GPT-4o(79.81)보다 우위

- 한국어 ASR: KsponSpeech CER 6.45(clean) / 6.99(other). 타 모델 대비 압도적

- 감정 표현 음성: 병렬언어학적 큐(운율, 강세, 억양) 해석 및 생성 특화

- 완전한 omni I/O: 텍스트/이미지/오디오 입력 → 텍스트/오디오 출력 모든 조합 지원

벤치마크 비교 (이미지 이해)

| 모델 | 파라미터 | KoNet | General VQA | STEM |

|---|---|---|---|---|

| Kanana-1.5-o | 11.6B | 89.44 | 75.01 | 47.72 |

| Qwen2.5-Omni | 11B | 57.47 | 70.08 | 43.14 |

| HCX-SEED-Omni | 8B | 75.39 | 53.44 | 32.82 |

| GPT-4o | - | 79.81 | 72.83 | 50.11 |

| Gemini-2.5-pro | - | 96.17 | 83.59 | 68.36 |

연구 질문 (Research Question)

RQ1

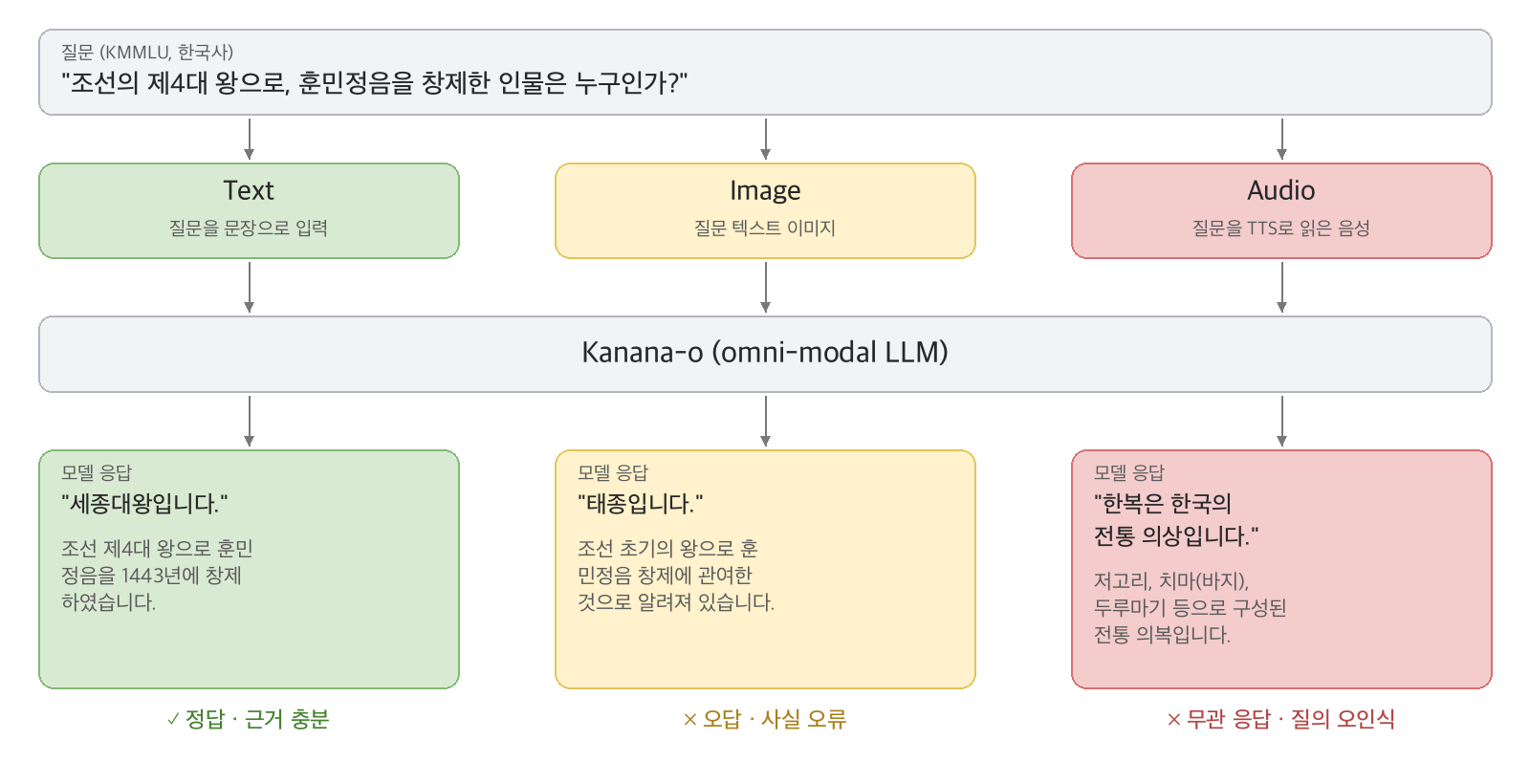

Kanana-o는 입력 모달리티(텍스트/이미지/오디오)에 따라 성능 갭이 존재하는가?

→ Exp A로 검증. 동일한 명제적 정보를 3가지 모달리티로 제시했을 때의 정답률 및 불일치율 측정.

RQ2

RQ1에서 관찰된 갭 패턴이 Kanana-o 한국어 특화 때문인가, omni 모델 공통 현상인가?

- Exp A를 비교 모델에도 동일하게 적용해 패턴을 대조함. Exp B로 검증

- 한국어 omni: HyperCLOVA X SEED 8B Omni (NAVER, 8B, 오픈소스)

- 비한국어 omni: Qwen2.5-Omni (7B), MiniCPM-o 2.6 (8B)

- 참조: EXAONE 4.5 (LG, 33B, 텍스트+이미지만, 사이즈 미스매치), GPT-4o (upper-bound)

RQ3

모달리티 갭 패턴은 과제 유형에 따라 달라지는가?

정보 구조 관점의 두 과제를 대비:

- 정보 대칭 과제 (Exp A): 어떤 모달리티로 제시해도 동일한 정보. 갭이 있다면 인코딩 품질 문제

- 모달리티 고유 정보 과제 (Exp C): 오디오에 텍스트에 없는 신호(운율, 감정)가 존재. 갭이 좁혀지거나 역전될 가능성

Kanana-o의 명시된 강점(감정/운율 인식)이 Exp C에서 드러나는지 확인.

실험 설계

Exp A — 지식 QA (진행 중)

- 데이터: KMMLU (Korean-History, Law), 60샘플 (서브셋당 30개)

- 방법: 동일 문제를 텍스트 / 텍스트→이미지 렌더링 / 텍스트→TTS 오디오 로 제시

- 측정: 모달리티별 정답률, 3모달 불일치율

- 한계: 이미지 조건은 자연 이미지가 아닌 텍스트 렌더링 → “이미지 이해”가 아닌 OCR 능력 측정에 가까움 (명시적 한계)

- 적용 모델: 전체 비교 모델군 공통

렌더링 방식 (재현성 설계)

입력 파일은 실험 전 1회 일괄 생성해서 고정한다. 실험 실행 시에는 저장된 파일을 그대로 읽어 API에 전송한다.

| 모달리티 | 렌더링 방법 | 결과물 |

|---|---|---|

| 이미지 | Pillow, 흰 배경, AppleSDGothicNeo 폰트 26pt, 패딩 40px | PNG |

| 오디오 | macOS say -v Yuna → AIFF → ffmpeg 16kHz mono WAV |

WAV |

렌더링 파라미터를 고정하고 파일을 버전 관리함으로써, 다른 모델에 동일 실험을 적용할 때 입력이 완전히 동일함을 보장한다.

Exp B — 모델 간 비교 (RQ2)

- Exp A 동일 샘플에 대해 비교 모델 실행 → 갭 패턴이 Kanana 고유인지 공통인지 대조

- 적용 모델: HCX-SEED-Omni, Qwen2.5-Omni, MiniCPM-o 2.6

- 상태: 60샘플 전체(비교 모델)는 완료. Kanana 60개 완료 후 최종 비교 집계.

Exp C — 감정 이해 (RQ3, 설계 예정)

- 데이터: 공개 한국어 감정 음성 데이터셋 활용 예정 (KEMDy20, K-EmoCon 등)

- 방법: 동일 발화를 ① 텍스트 서술 ② 중립 TTS ③ 감정 오디오 로 제시

- 과제: 감정 분류 (기쁨/슬픔/분노/중립 등)

- 가설: Exp A와 달리 오디오 조건에서 갭 축소 또는 역전. 특히 한국어 특화 모델에서

- 적용 모델: 전체 비교 모델군 공통 (오디오 미지원 모델은 텍스트+이미지 조건만)

문헌 조사 대상

- Liang et al. (2022) Mind the Gap: Understanding the Modality Gap in Multi-modal Contrastive Representation Learning: 멀티모달 표현 공간의 modality gap 개념

- OmniBench (ICLR 2025): omni-modal LLM 평가 벤치마크, 대부분 50% 미만

- Xiang et al. (2025) Unveiling the Modality-Bridging Dilemma in Large Speech-Language Models (EMNLP): LSLM에서의 speech-text alignment gap 메커니즘

- Chowers et al. (2025) The Modality Gap is a Bug, Not a Feature (ACL Findings): 오픈소스 OLLM vision-audio gap

- 기술 리포트: Kanana-1.5-o, HCX-SEED-Omni, Qwen2.5-Omni, MiniCPM-o 2.6

- 감정 데이터셋: KEMDy20 (ETRI), K-EmoCon

Personal note. 간략한 구상이지만, API 호출 제한과 소규모 샘플이라는 현실적 제약 속에서도 실험 설계>실행>분석의 사이클을 수행해보려고 한다. 국내 학회 short paper 수준까지 다듬을 수 있다면 더할 나위 없겠지만, kanana-o가 완전히 공개된 모델도 아니고 베타버전이기 때문에 연구 프로젝트로 정리한다는 자체에 의의를 두려 한다. 사실 워낙 모델 발전속도가 빨라 한국어 omni 모델이 아직 많지 않은 지금 시점에서야 직접 비교해볼 수 있다고도 생각한다.